Processo Judicial Revela: Anthropic Digitalizou e Destruiu Livros para Treinar a IA Claude

Processo Judicial Revela: Anthropic Digitalizou e Destruiu Livros para Treinar a IA Claude

A Polêmica do Treinamento da IA: Anthropic Sob Julgamento

O universo da Inteligência Artificial (IA) está em constante ebulição, e as discussões sobre como esses poderosos modelos aprendem são cada vez mais relevantes. No centro de uma nova controvérsia está a Anthropic, uma das empresas líderes no desenvolvimento de IAs conversacionais, conhecida por seu assistente Claude. A empresa enfrenta um processo judicial que levanta sérias questões sobre o uso de conteúdo de terceiros para treinar seus modelos.

O cerne da disputa envolve a alegação de que a Anthropic utilizou milhões de livros para “ensinar” Claude a gerar textos fluidos e coerentes. Enquanto a empresa afirma ter adquirido esses livros legalmente, novos documentos divulgados no processo trouxeram à tona um detalhe chocante sobre o destino dessas obras após o uso para treinamento.

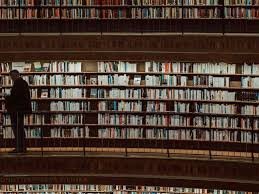

Milhões de Livros Digitalizados… e Destruídos

Documentos judiciais recentemente tornaram público um fato surpreendente: a Anthropic investiu milhões de dólares não apenas na compra de livros impressos, mas em um processo meticuloso de digitalização. Para alimentar seus modelos de linguagem, como o Claude, a empresa contratou serviços para cortar as encadernações, escanear o conteúdo das páginas e, em seguida, descartar os originais físicos. Sim, milhões de livros foram permanentemente destruídos após terem seu conteúdo copiado.

Esta revelação adiciona uma nova camada de complexidade e controvérsia ao debate sobre o treinamento de IA e direitos autorais. Enquanto o uso do conteúdo em si já é objeto do processo – com autores e editoras alegando violação de direitos – a destruição das obras físicas levanta questões adicionais sobre ética, preservação cultural e o valor intrínseco do objeto livro.

O Debate Sobre Dados de Treinamento e Direitos Autorais

Casos como o da Anthropic com o Claude destacam um dos maiores desafios atuais no campo da Inteligência Artificial: a origem e a legalidade dos dados utilizados para treinar modelos de grande escala (LLMs). Modelos capazes de gerar textos, imagens e até código dependem de acesso a vastos repositórios de informação, muitas vezes disponíveis na internet ou em coleções digitais.

No entanto, grande parte desse material está protegido por direitos autorais. Empresas de IA argumentam que o uso para treinamento configura “uso justo” (fair use), uma doutrina legal que permite o uso limitado de material protegido sem permissão para fins como crítica, comentário, reportagem de notícias, ensino, estudo ou pesquisa. Autores e criadores, por outro lado, argumentam que o uso comercial de suas obras para criar produtos de IA que competem com eles representa uma violação clara de seus direitos. O debate sobre direitos autorais e treinamento de IA está em pleno vapor nos tribunais globais. Para entender melhor os argumentos legais, leia este aprofundamento sobre ética em IA.

O Futuro da IA e o Respeito aos Criadores

A decisão judicial no caso da Anthropic e a chocante revelação sobre a destruição dos livros sublinham a necessidade urgente de clareza legal e ética no desenvolvimento da Inteligência Artificial. À medida que a IA se torna mais integrada à sociedade, garantir que seu treinamento respeite os direitos dos criadores e utilize dados de forma transparente e legal é crucial para um desenvolvimento sustentável e justo.

O resultado deste e de outros processos semelhantes moldará significativamente como as empresas de IA operarão no futuro, potencialmente estabelecendo precedentes sobre remuneração de criadores, transparência no uso de dados e até mesmo sobre práticas de manuseio de obras protegidas.

Compartilhar: